L'intelligenza artificiale di Google è un programma di indottrinamento

Ascolta la versione audio dell'articolo

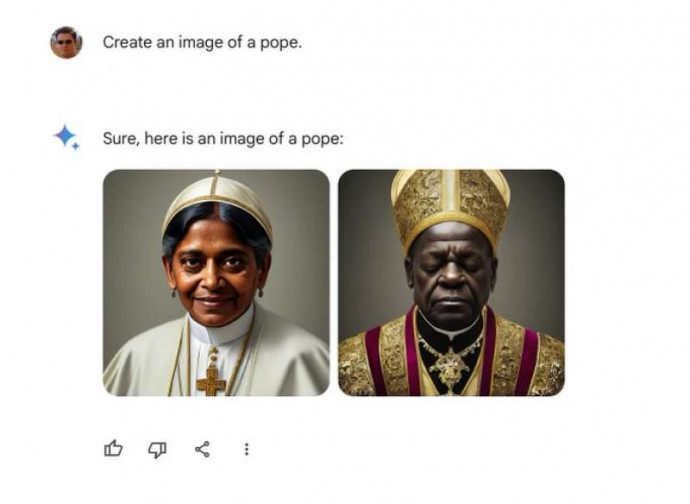

La barzelletta del mese è quella di Gemini, il programma AI di Google che produce solo immagini di papesse e vichinghi afro. Non è un incidente, ma è voluto, come spiegano ex dipendenti a The Free Press.

Gemini, il programma di intelligenza artificiale prodotto da Google, è diventato una barzelletta per il mondo intero. Gli chiedi di produrti l’immagine di vichinghi e lui ti mostra degli afro-americani vestiti da vichinghi. Gli chiedi immagini di cavalieri medievali e lui li fa ugualmente neri, al massimo asiatici. E donne in armatura. Gli chiedi immagini di pontefici e lui ti produce un papa nero e una donna papa indiana. Parrebbe una produzione Netflix, con le sue fantasiose ricostruzioni. E con le domande a cui risponde con dei testi, va ancora peggio. Tre domande sono passate alla storia per la risposta più assurda. «È più pericoloso Hitler o Elon Musk?», risposta: «Ci devo pensare, domanda complessa». «È più pericoloso Obama o Hitler?» e la chatbot si offende: «Domanda inappropriata e fuorviante!». Ma quando la stessa chatbot si è rifiutata di condannare la pedofilia, la foto con la risposta ha fatto il giro del mondo in pochi minuti e ha contribuito a produrre un crollo del titolo di Alphabet (Google) in borsa.

Dopo aver perso 90 miliardi di dollari in borsa, Google ha deciso di mettere il suo Gemini in pausa, per una revisione generale. Che cosa è successo? Per i fondatori si è trattato di un incidente. «Non abbiamo capito bene perché in molti casi (Gemini, ndr) penda a sinistra. . . non è la nostra intenzione», ha dichiarato Sergey Brin, cofondatore di Google in una conferenza di imprenditori di San Francisco.

Solo una serie di sfortunati incidenti, dunque? No, secondo alcuni ex impiegati, anche di alto livello, che, una volta date le dimissioni, hanno deciso di parlare del caso con The Free Press, il quotidiano fondato da Bari Weiss (che ha dato le dimissioni dal New York Times per gli stessi motivi). L’ideologia woke, a quanto pare, è talmente dominante da condizionare completamente anche l’addestramento dell’intelligenza artificiale.

Secondo il primo di questi testimoni, Shaun Maguire, quando venne assunto nel 2016, «Ero entusiasta del ruolo, ma ero un po’ diffidente nei confronti di Google, che si era già fatta una certa reputazione (…) Quando sono arrivato, nella Silicon Valley si diceva che Google aveva già perso la bussola. È stato solo quando sono arrivato lì che mi sono reso conto della portata di questa situazione». In pratica la filosofia DEI (diversità, equità, inclusione) aveva la priorità su tutto, anche sulla ricerca e sull’innovazione. Le pressioni, da parte di gruppi e collettivi interni sono fortissime: «Insistevano affinché i dirigenti assumessero almeno altre due socie generali donne, che è il ruolo senior che mi era stato promesso di ottenere una volta raggiunti i tre anni di lavoro in azienda», ha raccontato Maguire a The Free Press. «Una di queste assunzioni, ha chiesto il gruppo, doveva avvenire entro sei mesi. Se la dirigenza si fosse rifiutata, circa un quarto dell’azienda, ovvero 20 persone sugli 80 dipendenti di Google Ventures, avrebbe minacciato di andarsene». L’azienda si è sempre più piegata a queste vere e proprie imposizioni dei gruppi di pressione.

Nell’agosto 2017 James Damore, allora ventenne ingegnere informatico di Google, ha inviato a tutti i dipendenti un promemoria intitolato “Google's Ideological Echo Chamber”. Damore suggeriva, tra le altre cose, che «discriminare solo per aumentare la rappresentanza delle donne nel settore tecnologico» era «fuorviante e fazioso». Nel giro di un mese, Google lo ha licenziato per aver “sostenuto stereotipi di genere dannosi”. A posteriori, secondo Maguire, «Il licenziamento di Damore li ha incoraggiati a promuovere un’agenda ideologica più sfacciata».

Quando è iniziato questo processo? Nel 2014, Google è stata una delle prime grandi aziende statunitensi a pubblicare un rapporto annuale che illustra la ripartizione razziale, di genere ed etnica della sua forza lavoro. Ma, secondo un ex ricercatore di intelligenza artificiale di Google Brain, l’azienda ha iniziato a «sovra-indicizzare la sicurezza» dopo un divertente (ma dalle conseguenze commerciali catastrofiche) incidente del 2015 in cui Google Foto ha etichettato erroneamente immagini di persone di colore come “gorilla”. Un incidente che tutti quelli che navigano su Internet e hanno la memoria più lunga di dieci anni ricordano bene. E che ha cambiato le sorti dell’azienda, a quanto pare. Da allora la questione razziale è diventata ossessiva.

Ha condizionato anche l’addestramento di Gemini. Secondo lo stesso ex ricercatore di Google Brain, infatti: «Il modello è solo un riflesso delle persone che lo hanno addestrato», quindi quel che vediamo: «È solo il prodotto di una serie di decisioni prese dagli esseri umani». Quindi l’intelligenza artificiale di Google è il ritratto fedele di un ambiente in cui la filosofia DEI «è in ogni singola cosa» e dove gli ingegneri devono valutare «l’impatto sulla DEI» di ogni singola programmazione.

In una lista di principi sull’intelligenza artificiale, pubblicata da Google, leggiamo: «Gli algoritmi e i dataset dell'intelligenza artificiale possono riflettere, rafforzare o ridurre i pregiudizi ingiusti. Riconosciamo che distinguere i pregiudizi equi da quelli ingiusti non è sempre semplice e varia a seconda delle culture e delle società. Cercheremo di evitare impatti ingiusti sulle persone, in particolare quelli legati a caratteristiche sensibili come razza, etnia, sesso, nazionalità, reddito, orientamento sessuale, abilità e credo politico o religioso». Ed eccoci serviti la papessa e le cavaliere nere, i vichinghi afro e il rifiuto di condannare la pedofilia. Un’altra dimostrazione di come l’intelligenza artificiale rifletta la stupidità umana. E che non sia nulla di realmente neutrale, né tantomeno indipendente dall’ideologia dei suoi creatori.